"Le pasé el pliego a ChatGPT y me respondió bonito... ¿pero confío en eso?"

Esta es una conversación que ocurre cada vez más frecuentemente en equipos de licitación en Colombia. Alguien descubre que puede pegar el PDF del pliego en ChatGPT y recibir en segundos un resumen que parece coherente. Es tentador. Es rápido. Y funciona... hasta que no.

El problema no es que ChatGPT sea malo. El problema es que ChatGPT es un modelo de propósito general entrenado con datos generales de internet, y analizar un pliego de SECOP II no es una tarea de propósito general. Requiere datos muy específicos que ningún LLM genérico tiene.

Este artículo explica con precisión qué sí puede hacer un LLM genérico con un pliego de condiciones y dónde están los cinco límites reales. Y cómo LicitarUS fue construido específicamente para cubrir esos huecos.

Lo que ChatGPT sí hace bien con un pliego

Para ser justos, los LLMs genéricos de última generación (ChatGPT, Claude, Gemini) hacen bien varias cosas con un pliego de condiciones:

Resumen ejecutivo. Le das el documento y en segundos tienes un resumen del objeto del contrato, la entidad contratante, el presupuesto oficial y el plazo de ejecución. Para una primera lectura rápida de si el proceso es relevante para tu empresa, funciona.

Extracción estructurada de requisitos. Los LLMs son buenos extrayendo listas: "dame todos los requisitos habilitantes del pliego" produce resultados razonablemente útiles. No perfectos, pero dan un punto de partida.

Reformulación de cláusulas complejas. Un pliego con lenguaje jurídico denso puede pedírsele al modelo que lo explique en lenguaje más simple. Para orientar a alguien nuevo en el proceso, esto tiene valor.

Preguntas para la audiencia. "Con base en este pliego, ¿qué preguntas harías en la audiencia de aclaraciones?" produce preguntas que a veces son genuinamente útiles.

Hasta aquí, los LLMs son herramientas válidas. El problema aparece cuando se intenta ir más allá de lo que el modelo sabe.

Las 5 limitaciones críticas

Limitación 1: Sin acceso al historial de adjudicaciones de SECOP II

Esta es probablemente la limitación más costosa en términos prácticos.

Cuando ChatGPT analiza un pliego, no sabe:

- Cuántos oferentes participaron en el último proceso similar de esa entidad

- Qué precio pagó la entidad en contratos anteriores del mismo objeto

- Qué porcentaje del presupuesto oficial fue el precio adjudicado históricamente

- Si la entidad tiene historial de declaratorias desiertas en ese objeto contractual

Esos datos están en SECOP II, pero no en el entrenamiento de ningún LLM genérico. Sin ese contexto, cualquier recomendación sobre precio o estrategia competitiva es especulación, no análisis.

LicitarUS mantiene un índice procesado del historial de adjudicaciones de SECOP II que permite responder exactamente esas preguntas con datos reales.

Limitación 2: Sin base de conocimiento legal colombiana actualizada

El derecho de la contratación pública colombiana es técnico y está en constante evolución. La Ley 80 de 1993, la Ley 1150 de 2007, los decretos reglamentarios, los manuales del CCE, los conceptos de Colombia Compra Eficiente: hay cientos de fuentes relevantes que se actualizan regularmente.

Los LLMs genéricos tienen una fecha de corte en su entrenamiento y nunca tuvieron cobertura exhaustiva de estas fuentes específicas colombianas. Cuando ChatGPT cita una norma sobre contratación pública colombiana, hay una probabilidad no despreciable de que la cita sea parcialmente incorrecta, desactualizada o simplemente inventada con confianza.

En un proceso de licitación, citar mal una norma tiene consecuencias reales: una propuesta técnica basada en una interpretación legal incorrecta puede ser descalificada.

LicitarUS tiene una base de conocimiento legal curada específicamente para la contratación pública colombiana, con citas verificables y actualizadas.

Limitación 3: Alucinaciones con cifras y citas normativas

Los LLMs "alucinan" con confianza: producen respuestas que suenan correctas pero son incorrectas. Esto es especialmente peligroso con:

- Artículos específicos de normas ("el artículo 32 del Decreto 1082 establece que...": puede ser incorrecto)

- Plazos legales ("el plazo mínimo de publicación de un pliego es X días": puede estar desactualizado)

- Umbrales de cuantía ("los contratos de mínima cuantía para entidades tipo X son hasta Y SMMLV": puede no ser el valor vigente)

El problema no es que el modelo no sepa. El problema es que responde con el mismo tono de confianza cuando sabe que cuando inventa. El usuario promedio no puede distinguir cuándo confiar y cuándo verificar.

En una propuesta de licitación, una cifra normativa incorrecta en el análisis de habilitación puede costar la descalificación.

Limitación 4: Sin simulación econométrica del factor de adjudicación

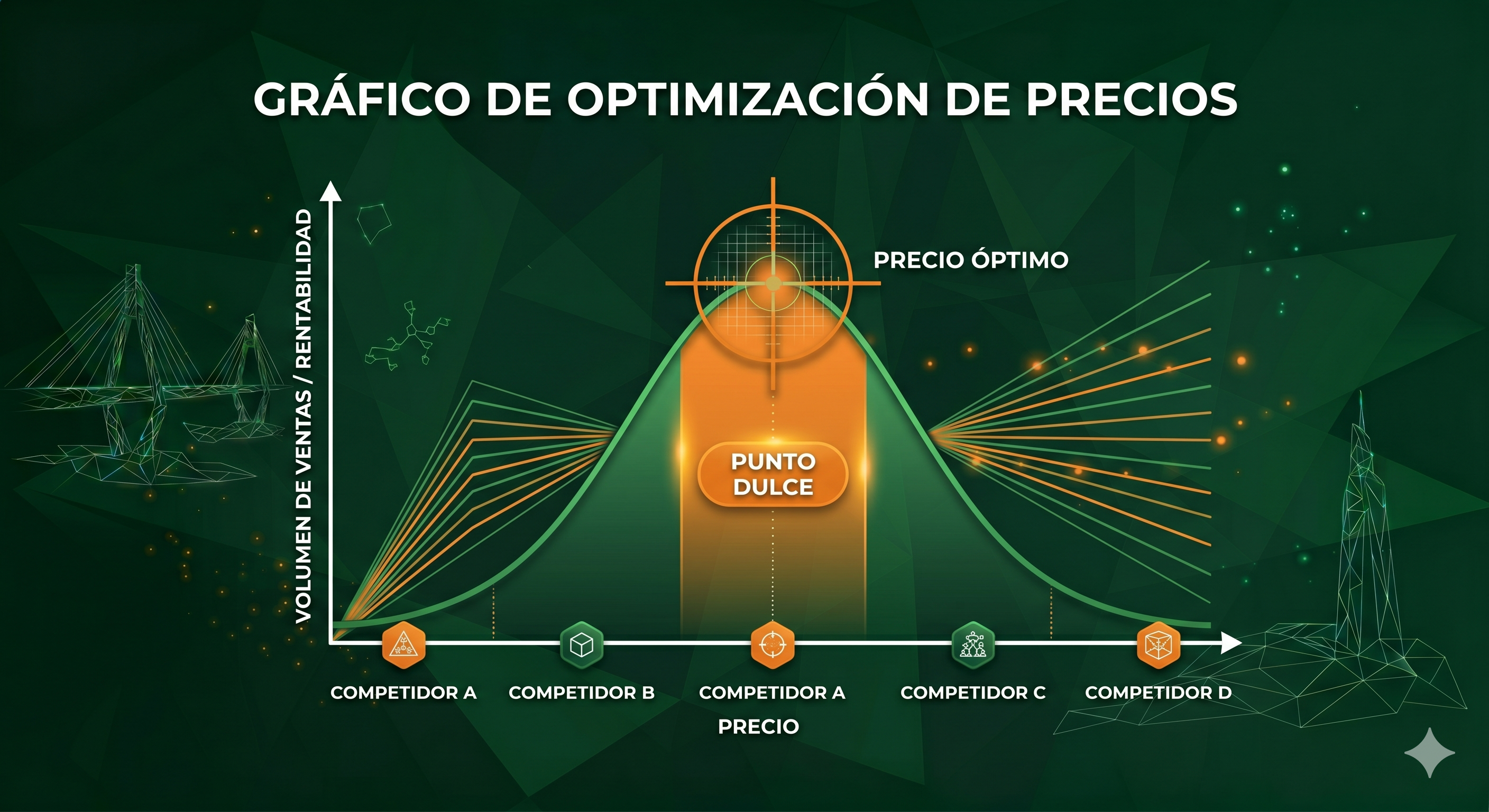

El factor de adjudicación econométrico es el corazón de la estrategia de precio en muchas licitaciones colombianas. Dependiendo del método de evaluación (media aritmética, media geométrica, menor valor, fórmula de puntaje, etc.), el precio óptimo no es el más bajo ni el promedio: es el que maximiza la puntuación esperada dado el comportamiento histórico de los otros oferentes.

ChatGPT no puede ejecutar ese cálculo. No tiene los datos históricos de la entidad, no conoce la distribución probable de ofertas de los competidores y no puede simular escenarios numéricos complejos con la lógica de las fórmulas de evaluación de SECOP II.

El Simulador de LicitarUS hace exactamente eso: modela el factor de adjudicación con base en el historial de la entidad y el método de evaluación del proceso específico.

Limitación 5: Sin memoria de los documentos propios de la empresa

Un análisis útil del pliego responde preguntas contra el perfil real de la empresa: "¿Cumplimos el requisito de experiencia probable con los contratos que tenemos en el RUP?", "¿Nuestros indicadores financieros actuales cumplen el índice de liquidez requerido?"

ChatGPT puede responder esas preguntas si le pegas el texto del RUP y el texto del pliego en el mismo contexto, pero eso tiene limitaciones de tamaño de contexto y no persiste entre conversaciones. Cada vez que empieza una nueva sesión, la empresa empieza desde cero.

LicitarUS permite cargar los documentos de la empresa una vez y consultarlos en cualquier análisis posterior mediante RAG persistente.

Ejemplo hipotético: el mismo pliego, dos respuestas

Imagina un pliego de consultoría en gestión de proyectos de infraestructura, con presupuesto oficial de 800 millones de pesos, método de evaluación económica por fórmula de media aritmética.

ChatGPT respondería algo así:

"El proceso tiene un presupuesto de 800 millones. Los requisitos habilitantes incluyen [lista extraída del pliego]. Se recomienda ofertar cerca del promedio estimado del mercado para maximizar la puntuación. [Sin datos concretos de referencia, sin cálculo del factor.] La norma aplicable sería el Decreto 1082 de 2015..."

La respuesta es plausible y presenta bien el texto del pliego. Pero el consejo de precio es vacío (¿qué es "cerca del promedio estimado"?), y la cita normativa puede o no ser la correcta.

LicitarUS respondería:

"Con base en el historial de esta entidad en los últimos 3 años para objetos similares: promedio de 4.2 oferentes, factor de adjudicación histórico entre 0.88 y 0.94 del presupuesto oficial. Con el método de media aritmética, el rango de precio que maximiza puntuación según la simulación econométrica está entre [rango calculado]. Los requisitos habilitantes extraídos del pliego son [lista verificada]. El artículo X del Manual del CCE establece... [con cita verificable]."

La diferencia no es cosmética. Es la diferencia entre preparar una oferta con y sin datos.

El veredicto

ChatGPT y otros LLMs genéricos son herramientas válidas para:

- Primera lectura rápida de un pliego desconocido

- Brainstorming de preguntas para la audiencia

- Explicación en lenguaje simple de cláusulas complejas

- Borradores de secciones narrativas de la propuesta técnica

LicitarUS es la herramienta para:

- Análisis operativo completo del pliego con datos verificables

- Inteligencia histórica de la entidad y el sector

- Simulación de precio con factor econométrico

- Consultas legales con citas verificables

- Evaluación contra los documentos propios de la empresa

El flujo más efectivo es usar ambos: ChatGPT para las tareas de primera lectura donde la eficiencia supera la necesidad de precisión absoluta, y LicitarUS para el análisis que informa las decisiones que importan.

Empieza a analizar tus pliegos con datos reales en licitarus.com/secop2.

Posicionamiento

Posicionamiento